- Produkt wycofany

|

Uwaga! Sprzedaż produktu została zakończona. Sprawdź inne w tej kategorii. |

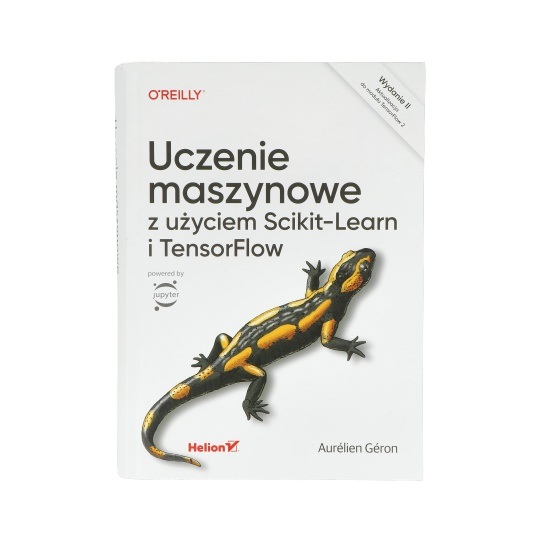

Opis produktu: Uczenie maszynowe z użyciem Scikit-Learn i TensorFlow. Wydanie II - Aurélien Géron

Drugie wydanie przewodnika po technikach uczenia maszynowego autorstwa Aurélien Géron. Dzięki tej książce można nauczyć się budowania i trenowania głębokiej sieci neuronowej, wystarczy posiadać minimalne umiejętności programistyczne.

Książka zawiera między innymi:

- podstawy uczenia maszynowego i rozpoczęcie pracy z TensorFlow

- techniki wykrywania obiektów, segmentacji semantycznej i mechanizmy uwagi

- interfejs Keras, narzędzia TF Transform i TF Serving

- wdrażanie modeli TensorFlow

- techniki uczenia nienadzorowanego, wykrywanie anomalii oraz biblioteka TF Agents

Uczenie maszynowe z użyciem Scikit-Learn i TensorFlow. Wydanie II - Aurélien Géron. Książka przeznaczona jest dla programistów.

Informacje o książce

- Autor: Aurélien Géron

- Tytuł oryginalny: Hands-on Machine Learning with Scikit-Learn, Keras, and TensorFlow: Concepts, Tools, and Techniques to Build Intelligent Systems, 2nd Edition

- Tłumaczenie: Krzysztof Sawka

- Wydawca: Helion SA

- Rok wydania: 2020

- Liczba stron: 768

- ISBN: 978-83-283-6002-0

- Format: 168 x 237 mm

O Autorze

Aurélien Géron - to konsultant do spraw uczenia maszynowego. Pracował w korporacji Google, a w latach 2013 – 2016 kierował zespołem klasyfikowania filmów w firmie YouTube. Był także założycielem i dyrektorem do spraw technicznych (w latach 2002 – 2012) w firmie Wifirst — czołowym francuskim dostawcy bezprzewodowych usług internetowych. Również w 2001 roku pełnił te same funkcje w firmie Polyconseil - obecnie zarządza ona usługą udostępniania samochodów elektrycznych Autolib’.

Spis treści

Przedmowa 15

CZĘŚĆ I. PODSTAWY UCZENIA MASZYNOWEGO 25

1. Krajobraz uczenia maszynowego 27

- Czym jest uczenie maszynowe? 28

- Dlaczego warto korzystać z uczenia maszynowego? 28

- Przykładowe zastosowania 31

- Rodzaje systemów uczenia maszynowego 33

- Główne problemy uczenia maszynowego 48

- Testowanie i ocenianie 55

- Ćwiczenia 57

2. Nasz pierwszy projekt uczenia maszynowego 59

- Praca z rzeczywistymi danymi 59

- Przeanalizuj całokształt projektu 61

- Zdobądź dane 65

- Odkrywaj i wizualizuj dane, aby zdobywać nowe informacje 78

- Przygotuj dane pod algorytmy uczenia maszynowego 84

- Wybór i uczenie modelu 92

- Wyreguluj swój model 96

- Uruchom, monitoruj i utrzymuj swój system 100

- Teraz Twoja kolej! 103

- Ćwiczenia 103

3. Klasyfikacja 105

- Zbiór danych MNIST 105

- Uczenie klasyfikatora binarnego 107

- Miary wydajności 108

- Klasyfikacja wieloklasowa 119

- Analiza błędów 121

- Klasyfikacja wieloetykietowa 124

- Klasyfikacja wielowyjściowa 125

- Ćwiczenia 127

4. Uczenie modeli 129

- Regresja liniowa 130

- Gradient prosty 135

- Regresja wielomianowa 145

- Krzywe uczenia 146

- Regularyzowane modele liniowe 150

- Regresja logistyczna 157

- Ćwiczenia 166

5. Maszyny wektorów nośnych 167

- Liniowa klasyfikacja SVM 167

- Nieliniowa klasyfikacja SVM 170

- Regresja SVM 175

- Mechanizm działania 177

- Ćwiczenia 186

6. Drzewa decyzyjne 187

- Uczenie i wizualizowanie drzewa decyzyjnego 187

- Wyliczanie prognoz 188

- Szacowanie prawdopodobieństw przynależności do klas 190

- Algorytm uczący CART 191

- Złożoność obliczeniowa 192

- Wskaźnik Giniego czy entropia? 192

- Hiperparametry regularyzacyjne 193

- Regresja 194

- Niestabilność 196

- Ćwiczenia 197

7. Uczenie zespołowe i losowe lasy 199

- Klasyfikatory głosujące 199

- Agregacja i wklejanie 202

- Rejony losowe i podprzestrzenie losowe 206

- Losowe lasy 206

- Wzmacnianie 209

- Kontaminacja 217

- Ćwiczenia 219

8. Redukcja wymiarowości 223

- Klątwa wymiarowości 224

- Główne strategie redukcji wymiarowości 225

- Analiza PCA 228

- Jądrowa analiza PCA 236

- Algorytm LLE 239

- Inne techniki redukowania wymiarowości 241

- Ćwiczenia 241

9. Techniki uczenia nienadzorowanego 243

- Analiza skupień 244

- Mieszaniny gaussowskie 266

- Ćwiczenia 280

CZĘŚĆ II. SIECI NEURONOWE I UCZENIE GŁĘBOKIE 283

10. Wprowadzenie do sztucznych sieci neuronowych i ich implementacji z użyciem interfejsu Keras 285

- Od biologicznych do sztucznych neuronów 286

- Implementowanie perceptronów wielowarstwowych za pomocą interfejsu Keras 300

- Dostrajanie hiperparametrów sieci neuronowej 323

- Ćwiczenia 330

11. Uczenie głębokich sieci neuronowych 333

- Problemy zanikających/eksplodujących gradientów 334

- Wielokrotne stosowanie gotowych warstw 347

- Szybsze optymalizatory 352

- Regularyzacja jako sposób zapobiegania przetrenowaniu 364

- Podsumowanie i praktyczne wskazówki 371

- Ćwiczenia 372

12. Modele niestandardowe i uczenie za pomocą modułu TensorFlow 375

- Krótkie omówienie modułu TensorFlow 375

- Korzystanie z modułu TensorFlow jak z biblioteki NumPy 379

- Dostosowywanie modeli i algorytmów uczenia 383

- Funkcje i grafy modułu TensorFlow 402

- Ćwiczenia 406

13. Wczytywanie i wstępne przetwarzanie danych za pomocą modułu TensorFlow 409

- Interfejs danych 410

- Format TFRecord 419

- Wstępne przetwarzanie cech wejściowych 425

- TF Transform 433

- Projekt TensorFlow Datasets (TFDS) 435

- Ćwiczenia 436

14. Głębokie widzenie komputerowe za pomocą splotowych sieci neuronowych 439

- Struktura kory wzrokowej 440

- Warstwy splotowe 441

- Warstwa łącząca 449

- Architektury splotowych sieci neuronowych 452

- Implementacja sieci ResNet-34 za pomocą interfejsu Keras 468

- Korzystanie z gotowych modeli w interfejsie Keras 469

- Gotowe modele w uczeniu transferowym 471

- Klasyfikowanie i lokalizowanie 473

- Wykrywanie obiektów 474

- Segmentacja semantyczna 481

- Ćwiczenia 484

15. Przetwarzanie sekwencji za pomocą sieci rekurencyjnych i splotowych 487

- Neurony i warstwy rekurencyjne 488

- Uczenie sieci rekurencyjnych 492

- Prognozowanie szeregów czasowych 493

- Obsługa długich sekwencji 500

- Ćwiczenia 511

16. Przetwarzanie języka naturalnego za pomocą sieci rekurencyjnych i mechanizmów uwagi 513

- Generowanie tekstów szekspirowskich za pomocą znakowej sieci rekurencyjnej 514

- Analiza sentymentów 522

- Sieć typu koder - dekoder służąca do neuronowego tłumaczenia maszynowego 529

- Mechanizmy uwagi 534

- Współczesne innowacje w modelach językowych 546

- Ćwiczenia 548

17. Uczenie reprezentacji za pomocą autokoderów i generatywnych sieci przeciwstawnych 551

- Efektywne reprezentacje danych 552

- Analiza PCA za pomocą niedopełnionego autokodera liniowego 554

- Autokodery stosowe 555

- Autokodery splotowe 562

- Autokodery rekurencyjne 563

- Autokodery odszumiające 564

- Autokodery rzadkie 566

- Autokodery wariacyjne 569

- Generatywne sieci przeciwstawne 574

- Ćwiczenia 587

18. Uczenie przez wzmacnianie 589

- Uczenie się optymalizowania nagród 590

- Wyszukiwanie strategii 591

- Wprowadzenie do narzędzia OpenAI Gym 593

- Sieci neuronowe jako strategie 597

- Ocenianie czynności: problem przypisania zasługi 598

- Gradienty strategii 600

- Procesy decyzyjne Markowa 604

- Uczenie metodą różnic czasowych 607

- Q-uczenie 609

- Implementacja modelu Q-uczenia głębokiego 612

- Odmiany Q-uczenia głębokiego 616

- Biblioteka TF-Agents 619

- Przegląd popularnych algorytmów RN 637

- Ćwiczenia 639

19. Wielkoskalowe uczenie i wdrażanie modeli TensorFlow 641

- Eksploatacja modelu TensorFlow 642

- Wdrażanie modelu na urządzeniu mobilnym lub wbudowanym 658

- Przyspieszanie obliczeń za pomocą procesorów graficznych 661

- Uczenie modeli za pomocą wielu urządzeń 673

- Ćwiczenia 688

- Dziękuję! 688

A. Rozwiązania ćwiczeń 691

B. Lista kontrolna projektu uczenia maszynowego 725

C. Problem dualny w maszynach wektorów nośnych 731

D. Różniczkowanie automatyczne 735

E. Inne popularne architektury sieci neuronowych 743

F. Specjalne struktury danych 751

G. Grafy TensorFlow 757

Przydatne linki |