Spis treści:

- 1 Nie kombinuj

- 2 Homo ludens. Uwielbiamy się bawić i wygłupiać

- 3 Stulta lex, sed lex

- 4 A nie ma tam jakiegoś komentarza do ustawy?

- 5 Każdy jest prawnikiem, czyli prawa eponimiczne

- 6 A na co to komu potrzebne?

- 7 Zapiszcie to gdzieś, szybko, zanim zapomnimy

- 8 Co na to Scientific American?

- 9 Scena gotowa, publiczność czeka, aktorów brak

Pisarze SF uwielbiają ustanawiać prawo, a wielu z nich ma nadzieję wynaleźć jakieś wielkie, dowcipne prawo istnienia, które na zawsze będzie nosić ich nazwisko. Może dlatego, że wielu z nich jest nerdami. Amerykański twórca sci-fi, fantasy i horroru Theodore Sturgeon, kiedy powiedziano mu, że dziewięćdziesiąt procent fantastyki naukowej to badziewie, krótko później sformułował Prawo Sturgeona: “Dziewięćdziesiąt procent wszystkiego jest g*…*nem”. Dosłownie. I zasłynął.

Czemu lubimy tworzyć koncepcje? Po co są nam nierealne pomysły, postaci i właściwie całe światy? Poświęcamy tak dużo energii pasjonującym ideom, z których nic nie przychodzi. Nic praktycznego, ma się rozumieć. Gonimy w wyobraźni za tym, co może być i jakąś niespotykaną radość nam to przynosi. No więc czemu? Bo uwielbiamy dobre historie. Bo to świetna rozrywka dla mózgu, i to nie tylko dla mózgu w wieku dziecięcym. Dobre fabuły, dobre mniej lub bardziej zmyślone opowieści, wszystko to dla nas jak miód. Uwielbiamy opowiadać pasjonujące, emocjonujące, wzruszające… pierdoły. Dla tych, którzy nie potrafią tworzyć w umyśle wyimaginowanych obrazów, powstało nawet określenie fenomenu – afantazja. Życie bez dostępu do wyobraźni.

Nie kombinuj

Skup się na faktach! Dobra, nie komplikuj! Po co tak analizujesz!? Słyszeliśmy to dziesiątki albo setki razy.

W ostatnich latach popularność zyskało młodzieżowe słowo kminić. Pochodzi od rzeczownika kmina z więziennej grypsery. Synonimy to czaić albo kumać. Czasownik kminić oznacza głęboko, intensywnie nad czymś myśleć. Można więc:

- kminić, rozkminiać – oddawać się rozmyślaniom, często bezsensownym,

- rozkminić – zrozumieć, często po sporym wysiłku,

- wykminić – wymyślić, często na siłę,

- przekminiać – zanadto analizować, przekombinowywać.

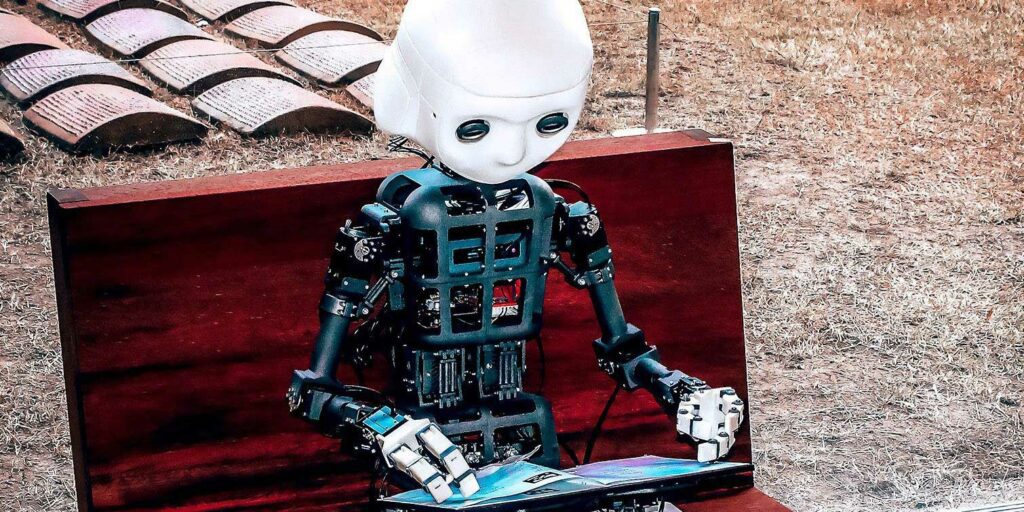

My dziś będziemy kminić nad ostatnim – czyli przekminianiem pewnych zagadnień na przykładzie praw robotów. W języku angielskim mówi się na to overthinking. Oznacza to poświęcanie problemowi więcej uwagi, niż to konieczne. Coś jak robić z igły widły. Według wielu tym właśnie są dyskusje toczone wokół prawa robotów. No dobra, no to rozkminiamy, a później odpoczniecie sobie od myślenia na spacerze.

Homo ludens. Uwielbiamy się bawić i wygłupiać

Wymyślamy dla zabawy. To podstawowy i zupełnie naturalny instynkt człowieka, aby wyobrażać sobie rzeczy, ponieważ ludzie są najbardziej zaawansowaną formą życia na tej planecie. Wyobrażamy sobie, bo możemy. A skoro jesteśmy tak zaawansowaną formą życia, to wśród sposobów rozwoju mózgu mieszczą się relaks i rekreacja. W omawianiu literatury pięknej wśród teoretyków literatury nazywa się to ludyczność – cecha dzieł polegająca na zdolności do zaspokajania potrzeby rozrywki. Ma to swoje podstawy w kulturze.

Wymyślamy nawet na nowo nie tylko maszynę, ale i… człowieka. Określenie Homo sovieticus, czyli bezmyślny odbiorca komunizmu powstało jako fenomen w odpowiedzi na komunizm. Homo roboticus to koncepcja w odpowiedzi na mające nadejść androidy i cyborgi. Podgatunków Homo ciągle przybywa. Jest też Homo ludens. Taki właśnie tytuł nosi książka wydana po 1938 roku przez teoretyka kultury Johana Huizingę. Omawia ona znaczenie elementu zabawy w kulturze i społeczeństwie sugerując, że zabawa jest pierwotnym i koniecznym (choć niewystarczającym) warunkiem powstawania kultury.

Stąd też często słyszana odpowiedź: Możemy się powoływać na mądre hasła, że prawa robotów wymyślamy zawczasu jako podwaliny teoretyczne do późniejszego, faktycznego ich formułowania. Gadajmy sobie ile chcemy, to nadal wymyślanie dla rozrywki i taki pościg za zajączkiem. A przecież chodzi o to, żeby zajączka gonić, a nie żeby złapać.

Stulta lex, sed lex

Czyli głupie prawo, ale prawo. Z pewnością najbardziej znane prawa w science-fiction to te od Asimova. Robot nie może wyrządzić krzywdy człowiekowi, ani przez bezczynność dopuścić do tego, by człowiekowi stała się krzywda. Robot musi słuchać rozkazów wydawanych mu przez ludzi, z wyjątkiem sytuacji, w których takie rozkazy byłyby sprzeczne z Pierwszym Prawem. Robot musi chronić swoje własne istnienie, o ile taka ochrona nie stoi w sprzeczności z Pierwszym lub Drugim Prawem. Było.

Brzmią jak Prawa Robotyki Isaaca Asimova, ale według Davida Langforda są to prawa robotyki praktycznie nieznanego w Polsce pisarza SF Johna Sladka – to z jego Asimovskiej parodii Broot Force opatrzonej nagłówkiem I-click As-I-move. Sladek wyjaśnił, że sformułowania są prawie identyczne, ale mimo to są to Three Laws of Robish, czyli właśnie ich parodia. Sam Asimov dodał później czwarte lub zerowe prawo, które mówiło mniej więcej: “Po namyśle, roboty mogą zabijać i krzywdzić ludzi ile tylko chcą, jeśli jest to w szczytnym celu”. Dzisiaj kolejni próbują je nie tylko interpretować, ale też przetwarzać.

Prawa robotów Asimova albo o etyce w robotyce

Rozpoznajemy intencje Isaaca Asimova patrząc na trzy prawa robotyki – bodaj najważniejszy wkład do współczesnego robo science fiction.

Według Langforda roboty przyszłości będą raczej postępować zgodnie z… Prawami Robotyki Langforda, które, jak sam przyznaje, wymyślił na jakimś konwencie fanów SF. Po pierwsze robot nie skrzywdzi upoważnionego personelu rządowego, ale zlikwiduje intruzów z wyjątkową pilnością. Po drugie robot będzie posłuszny rozkazom upoważnionego personelu, z wyjątkiem sytuacji, gdy takie rozkazy są sprzeczne z Trzecim Prawem. Po trzecie robot będzie strzegł własnego istnienia za pomocą śmiercionośnej broni przeciwpiechotnej, ponieważ “robot jest cholernie drogi”. Tak też z pogawędki o tematyce skupionej wokół luźnej krytyki autorytetów powstało coś, co zapisało się w kulturze popularnej – nie pierwszy i nie ostatni raz.

A nie ma tam jakiegoś komentarza do ustawy?

Arthur C. Clarke nie zamierzał pozwolić, by jego stary rywal Asimov go wyprzedził, więc wymyślił trzy własne prawa dotyczące nowoczesnych technologii. Jak skromnie zauważył trzy wystarczyły Newtonowi, więc jemu też taka ilość pasuje. Jedno z nich brzmi: “Kiedy wybitny, ale starszy naukowiec stwierdza, że coś jest możliwe, prawie na pewno ma rację. Kiedy natomiast stwierdza, że coś jest niemożliwe, to z dużym prawdopodobieństwem się myli.”

Asimov, który popełnił różne dość średniawe bestsellery, ale jednak bestsellery, szybko dodał poprawkę: kiedy laicy gromadzą się wokół idei, która jest potępiana przez wybitnych, lecz starszych i szanowanych naukowców, i popierają ją z wielkim zapałem i emocjami, to wybitni, lecz starsi naukowcy mają wtedy, mimo wszystko, prawdopodobnie rację”. To aż za celne. Wie to każdy, kto dostatecznie długo przebywał w środowisku akademickim.

Trzecie prawo Clarke’a jest jego najlepszym. “Każda dostatecznie zaawansowana technologia jest nieodróżnialna od magii”. Tym razem następstwa dostarczył autor science-fiction Gregory Benford: “Każda technologia, którą można odróżnić od magii, jest niewystarczająco zaawansowana”. Blisko stąd do technologicznej osobliwości.

Technologiczna osobliwość – co to jest? Kiedy nadejdzie?

Najedzie coś, co wywróci nasz świat do góry nogami. I to dosłownie. A potem nic już nie będzie takie samo. Poszukujemy dziś z Wami technologicznej osobliwości.

Matematyk i pisarz Larry Niven lubuje się w wymyślaniu uniwersalnych praw i w opowieściach Known Space: The Future Worlds of Larry Niven wymyślił dwadzieścia głębokich, filozoficznych spostrzeżeń. Fajnie się nad nimi dyskutuje, fajnie przypuszcza i wróży z fusów. Niektórych nawet to śmieszy. Nie ma sensu ich przytaczać, bo nie dość, że są rozsypane tematycznie jak monolog pijanego kumpla na balkonie nad ranem, to część jest tak ogólna, że właściwie można je przypiąć do wszystkiego. No, i to by było na tyle.

Każdy jest prawnikiem, czyli prawa eponimiczne

Poul William Anderson mądrze powstrzymywał się od wymyślania nowych praw, ale za to nalegał, by… handel międzygwiezdny działał według znanych już zasad, takich jak Prawo Parkinsona, a przede wszystkim Prawo Murphy’ego: “Wszystko, co może pójść źle, pójdzie źle”. Kolejny lekki powodzik, aby pogadać o czymś, co nie istnieje, ale osadzić to w zabawnym i mającym zdradzać inteligencję i polot autora kontekście. W erze memów i post-humoru, kiedy śmieszy już wszystko i nie śmieszy nic, takie rzeczy czyta się i omawia tylko na salonach wśród przedstawicieli branży.

Nikomu nie zabieramy prawa do tworzenia prawa. I tak nie będzie usankcjonowane i nikt nie będzie go przestrzegał. Wymyślać możemy do woli, czego dowodzi długa lista zebrana na Wikipedii. Część z nich to zaobserwowane reguły ujęte w prawa na miarę, czyli na poważnie, inne to żartobliwe określenia dotyczące codziennego życia. Eponimy, czyli określenia pochodzące od nazw własnych, wzbogacają nasz język, owszem. My też możemy stworzyć sobie Prawo Botlandu jako zespół. Jak już jakieś wymyślimy, to damy znać. Tymczasem wróćmy do robotów.

A na co to komu potrzebne?

Sporo dyskusji wywołuje sensowność praw robotów. Według wielu nie ma sensu dyskutować o prawach czegoś, co jeszcze nie powstało. No właśnie – nie powstało, ale co? Robotyczna świadomość? Prace nad sztuczną inteligencją naprawdę mkną do przodu. Zapewne trzeba by tutaj wyraźnie zdefiniować świadomość. Gorzej, że wciąż nie wiemy, skąd tak naprawdę się ona bierze. Roboty ze sztuczną świadomością musiałyby, mówiąc najprościej, wyjść poza swoje programowanie. Jedna z wiodących do tego dróg prowadzi przez uczenie maszynowe i sieci neuronowe, ale to już wiecie.

Kolejna sprawa – prawa powstały po to, aby… nie cierpieć. Prawo organizuje nasze życie, wprowadza do niego harmonię i chroni tych, którzy bez prawa byliby wykorzystywani. Przynajmniej takie są założenia. Według innych chroni tych “na górze”, czyli tych, którzy wykorzystują. Bezpiecznie pozostać przy tezie, że najłatwiej sformułować prawo w nieuczciwy sposób oczywiście tym, którzy je formułują, czyli tworzą. Jeżeli prawa robotów będą tworzyć ludzie, to dyskusja rozgorzeje na nowo tak, jak przed uchwalaniem jakiegokolwiek innego prawa. A któż inny miałby to robić?

Temat powrócił w kontekście Sophii, robota, który jako pierwszy otrzymał obywatelstwo kraju. Niestety w jego przypadku była to Arabia Saudyjska, która należy do grupy państw, w których prawa człowieka są stale łamane. Jeżeli Sophia to kobieta, a tak sugeruje jej imię i generalnie mówiąc przyświecająca robotowi konstrukcja, to ma ona krótko mówiąc przekichane.

Poza tym niespecjalnie chce się komukolwiek żartować z kraju, w którym kobiety do 2018 roku nie mogły jeździć samodzielnie samochodem, od dwunastego roku życia muszą unikać miejsc uczęszczanych przez mężczyzn, obowiązuje ścisła segregacja według płci, a odbywające wyroki więźniarki są wykorzystywane seksualnie. Jeżeli czeka nas bunt robotów, to dobrze, że Sophia weszła w krąg obywatelek Arabii Saudyjskiej. Jeżeli bunt ma oznaczać nie rewolucyjne przejęcie władzy, a rebelię prowadzącą do społecznych zmian na rzecz równości, to jesteśmy za. Choć raczej nie liczmy, że roboty załatwią cokolwiek z takich spraw za nas, jeżeli sami się za siebie nie weźmiemy.

Zapiszcie to gdzieś, szybko, zanim zapomnimy

Trochę ponudzimy, żeby zaraz się rozkręcić. Prawo jako zbiór norm postępowania może powstawać w wielu formach i jest rezultatem różnych faktów prawotwórczych, czyli faktów tworzących prawo. Weźmy cztery fakty prawotwórcze.

- Kształtowanie się prawa zwyczajowego.

- Stanowienie.

- Umowa.

- Precedens.

Prawo zwyczajowe możemy pominąć z oczywistych względów – to proces długi, skomplikowany i oparty na przekonaniu, że jakiś utarty zwyczaj przyjął się i jest okej. Doświadczenia z robotami, które zdobywamy już teraz, na pewno będą miały wpływ na formułowanie praw dla sztucznej inteligencji, bez dwóch zdań. Temat jest jednak zbyt poważny, aby powierzyć go obiegowej opinii.

Nas raczej interesuje kwestia tego, czy prawo będzie stanowione przez kompetentny organ, który będzie “żądał” realizacji norm prawnych, czy też będzie wynikiem umowy z myślącymi robotami. Czy roboty będą w tworzeniu prawa partnerem i podmiotem, czy tylko podmiotem bezwolnym? Nie jesteśmy specjalistami w prawniczej terminologii, ale spójrzmy na to tak, żeby każdy wiedział, o co chodzi – czy organ tworzący prawo zapyta w ogóle roboty o zdanie, albo czy odbędą się rozmowy przy okrągłym stole? W odróżnieniu od aktów stanowienia taka umowa społeczna jako fakt prawotwórczy jest czynnością co najmniej dwustronną, więc podmioty zawierające umowę nazywa się tu stronami. Strony uczestniczące w umowie ustalają wiążące je normy generalne i abstrakcyjne. Twórca norm staje się też ich adresatem.

A może precedens? Dość niebezpieczna sprawa, jeżeli rozwój AI będzie tylko przyśpieszał. Trudno sobie to wyobrazić zwłaszcza w wizjach tych, którzy wychowali się i funkcjonują w systemie prawa kontynentalnego, gdzie prawdziwego precedensu szukać ze świecą. Precedens to wydarzenie stanowiące punkt odniesienia i usprawiedliwienia dla podobnych, późniejszych wydarzeń oraz w kontekście prawniczym orzeczenie sądu, które ma moc wiążącą w odniesieniu do późniejszych orzeczeń w podobnych sprawach. Precedens z założenia skupia się na tym, co wydarzyło się wcześniej, więc jakiś akt z udziałem robota, który miał miejsce wcześniej, będzie w tym wypadku kluczowy dla tworzenia prawa. Jak to będzie wyglądało w sprawach karnych – to już w ogóle czarna magia. Może dotyczyć spadku i nieszczęśliwego wypadku, ale także kradzieży albo morderstwa.

Po rekomendacje odsyłamy tutaj – to zalecenia dla Komisji Prawnej UE w sprawie przepisów prawa cywilnego dotyczących robotyki. We wprowadzeniu oficjalnego dokumentu wspólnotowego pojawiają się Frankenstein Mary Shelley, Karel Capek, prawa Asimova! Czy ktoś tu jeszcze ma wątpliwości, że temat jest poważny?

Co na to Scientific American?

W ręce wpadł nam ciekawy artykuł zaczerpnięty z portalu The Conversation. Otwiera go teza, że zamiast praw ograniczających zachowanie robotów, powinny one mieć możliwość wyboru najlepszego rozwiązania dla danego scenariusza. Autor prezentuje pójście krok dalej w krytyce praw robotyki Asimova. Według niego opowiadania autora są dekonstrukcją jego własnych praw pokazującą, jak wielokrotnie zawodzą one w różnych sytuacjach. Taka autokrytyka. Większość prób opracowania nowych wytycznych opiera się na zasadzie, aby stworzyć bezpieczne, zgodne z przepisami i wytrzymałe roboty. Jednak praktyka życia pokazuje najlepiej, gdzie to wszystko może się wywrócić na plecy.

Jednym z problemów związanych z jednoznacznie sformułowanymi wytycznymi dla robotów jest konieczność przełożenia ich na format, z którym roboty mogą pracować. Coś jak powszechny system etyczny i behawioralny. Powszechny, ale niekoniecznie uogólniony, bo to nie to samo! Zrozumienie pełnego zakresu ludzkiego języka i reprezentowanego przez niego doświadczenia jest dla robota bardzo trudnym zadaniem. Cele behawioralne, takie jak zapobieganie krzywdzie ludzi lub ochrona istnienia robota, mogą oznaczać różne rzeczy w różnych kontekstach. Trzymanie się reguł może doprowadzić do tego, że robot nie będzie w stanie działać tak, jak chcieliby tego jego twórcy, i nie mówimy tu o spadaniu ze schodów albo wyrżnięciu czołem w półkę. Ścisłe reguły są dobre, gdy wysyłamy jeżdżącego robota na tor, a nie na wieczór w restauracji.

Zastosowanie ogólnych zasad zamiast predefiniowanych, konkretnych reguł zachowania pozwoliłoby robotowi na uwzględnienie kontekstu i ocenę scenariuszy, których nikt wcześniej nie przewidział. Na przykład, zamiast zawsze przestrzegać zasady “nie popychaj ludzi”, robot generalnie unikałby popychania ich, ale mimo to byłby w stanie zepchnąć ich z drogi spadającego obiektu. Człowiek nadal mógłby ucierpieć, ale w mniejszym stopniu, niż gdyby robot go nie popchnął. I co? I kółko – zatoczyliśmy krąg do początku artykułu, czyli tematu świadomości. Bo to o nią właśnie wszystko się tu opiera.

Scena gotowa, publiczność czeka, aktorów brak

Jak stworzyć coś nowego? Albo lepiej: nowe życie? Na razie sposoby są dwa – począć dziecko albo wyhodować pleśń na kanapce zostawionej na wakacje w plecaku. Podsumujmy już to czcze gadanie, które jednych niezdrowo podnieca, innych mierzi i wkurza, a jeszcze innych przyprawia o “bezpodstawne przekminianie”. Całe to przebieranie nogami, abyśmy mogli wreszcie przekonać się o wszystkim jako społeczeństwo w praktyce, musi mieć swoje blaski i cienie.

Prawo nie działa wstecz. O tym mówili już starożytni. Nie działa też w przód. Tak jak do “dura lex, sed lex” stworzyliśmy “stulta lex, sed lex”, tak i do maksymy “lex retro non agit” możemy dołączyć “lex ex ante non agit”. Znawcy łaciny z pewnością wybaczą nam tutaj ewentualne potknięcia. Tworzenie podwalin teoretycznych może mieć jednak swoje dobre strony, nawet jeżeli ostatecznie okażą się spudłowane. Wymyślanie praw robotów to naszym zdaniem:

1. Okazja do zabawy. Czerpanie przyjemności z teoretyzowania i “wróżenia z fusów” o tym, co nie jest, ale kiedyś być może.

2. Świadomość rozwoju technologii. Skoro technologia AI rozwija się tak szybko, to w końcu prawa będą potrzebne.

3. Przygotowania “na zaś”. Tworzymy etyczne podstawy do czegoś, co dopiero powstanie w praktyce.

4. Wyraz troski albo lęku. Im szybciej, tym lepiej. Jeśli przyjdą czarne scenariusze, to lepiej przypilnować sprawy teraz.

W trakcie pisania artykułu przyszło nam do głowy pytanie: kto odpowiada za wypadek w przypadku autonomicznego samochodu, siedzący w środku kierowca (eee, pasażer?) czy producent pojazdu? Kilka stuknięć w klawiaturę, rzut okiem na wyniki Google i proszę, jest mowa o wypadku śmiertelnym.

Czy wielka premiera AI okaże się pięknym musicalem harmonijnej gry człowieka i robota, czy raczej horror operą? Na to próbowaliśmy odpowiedzieć już kilka razy, a każdy i tak tworzy sobie odpowiedź sam. Lepsze pytanie brzmi: kto będzie odpowiadał za reflektor w momencie, gdy robot-oświetleniowiec zrzuci je na lożę VIPów? Poza tym, gdybyście się jeszcze nie zorientowali, niniejszy artykuł dotyczy formułowania właściwie dowolnych teorii i predykcji na temat technologii.

Jak oceniasz ten wpis blogowy?

Kliknij gwiazdkę, aby go ocenić!

Średnia ocena: 5 / 5. Liczba głosów: 1

Jak dotąd brak głosów! Bądź pierwszą osobą, która oceni ten wpis.